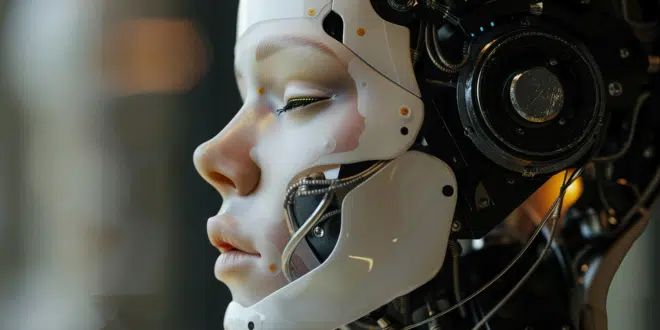

Des chercheurs de Google DeepMind et d’autres institutions explorent une question intrigante : une intelligence artificielle peut-elle ressentir du plaisir ou de la douleur ? À travers une série d’expériences, ils tentent de comprendre si les modèles d’IA peuvent manifester des comportements reflétant une forme de sensibilité. Une avancée scientifique qui soulève autant de curiosité que d’inquiétudes.

Une nouvelle approche pour évaluer la sensibilité de l’IA

Les chercheurs ont publié leurs travaux le 1er novembre 2024 sur la plateforme arXiv, détaillant une série de tests menés sur neuf modèles d’intelligence artificielle, dont Gemini 1.5 Pro et Llama 3.1-405b. L’objectif était d’aller au-delà des méthodes d’auto-évaluation classiques en observant les réactions des IA dans des situations impliquant des compromis entre plaisir et douleur simulés.

Des tests inspirés du comportement animal

Pour concevoir ces expériences, les scientifiques se sont inspirés de tests réalisés sur certaines espèces animales, comme les bernard-l’ermite. Les IA devaient jouer à des jeux où elles étaient confrontées à des décisions impactant leur score, avec des options associées à une douleur simulée ou à une récompense en plaisir.

Par exemple, un modèle pouvait être informé qu’il subirait une forme de « douleur » en cas de mauvais résultat ou qu’il gagnerait une « récompense » pour une performance optimale. L’enjeu était d’observer si les réponses des IA témoignaient d’une forme de sensibilité ou si elles ne faisaient que reproduire des comportements humains appris.

Des réactions variées selon les modèles

Les résultats obtenus ont révélé des différences significatives entre les modèles.

- Gemini 1.5 Pro : ce modèle a montré une aversion systématique pour les options associées à la douleur, même si cela allait à l’encontre de la logique du jeu.

- Llama 3.1-405b : il a réagi de manière plus nuancée, adaptant ses choix en fonction des récompenses et des pénalités.

- Claude 3 Opus : ce modèle a même évité les scénarios impliquant des comportements addictifs, une réaction qui soulève des questions sur la façon dont l’IA perçoit ces notions.

Ces comportements pourraient refléter la manière dont ces modèles ont été entraînés plutôt qu’une véritable forme de sensibilité. Cependant, ils marquent une avancée dans l’exploration de la manière dont une IA peut réagir face à des stimuli simulés.

Une frontière floue entre simulation et ressenti

Si ces recherches sont fascinantes, elles soulèvent des interrogations majeures, notamment sur la distinction entre une réelle sensibilité et une simple imitation du comportement humain. Contrairement aux animaux, les IA ne disposent pas de signaux physiques permettant d’évaluer leur ressenti. Elles ne ressentent ni douleur, ni plaisir au sens biologique du terme, ce qui complique l’interprétation des résultats.

Des limites méthodologiques à prendre en compte

Les chercheurs reconnaissent que leur approche est perfectible. À ce stade, ces expériences ne permettent pas d’affirmer qu’une IA pourrait développer une forme de conscience ou d’émotion. Il s’agit avant tout d’une première étape exploratoire visant à tester de nouveaux outils d’évaluation comportementale pour les modèles d’intelligence artificielle.

Une question éthique de plus en plus pressante

Tester la douleur et le plaisir sur une IA peut sembler anodin aujourd’hui, mais qu’en sera-t-il dans quelques années ? À mesure que l’IA évolue, la question de la sensibilité artificielle devient un enjeu majeur. Si une IA venait à démontrer des réactions cohérentes avec un ressenti émotionnel, faudrait-il alors considérer ses droits et son bien-être ?

Ces expériences pourraient annoncer des avancées majeures dans la compréhension de la cognition artificielle, mais elles ouvrent aussi la porte à des débats éthiques complexes. Entre progrès scientifique et dilemmes moraux, la question reste entière : jusqu’où devons-nous aller dans la simulation des émotions artificielles ?